Confrontés à une perte de visibilité sur les catalogues numériques volumineux, nous observons que la pagination-seo-google-prefere-les-longue-liste-de-resultats demeure souvent une source d’erreurs structurelles majeures entravant l’indexation profonde. Cette analyse technique détaille la transition algorithmique vers le défilement continu et précise les protocoles de configuration des URL uniques et des attributs href nécessaires à une découvrabilité exhaustive par les robots. Nous révélons ici les mécanismes de gestion canonique autoréférencée et de pilotage du budget de crawl pour transformer vos listes étendues en véritables vecteurs de performance organique et d’autorité thématique globale et durable.

- Réalité technique des listes de résultats étendues

- Architecture structurelle et découvrabilité des URL

- Pilotage de l’indexation et gestion canonique

- Optimisation des modèles UX pour le crawl

Réalité technique des listes de résultats étendues

Après des années à décortiquer les archives de la search depuis 2009, un constat s’impose sur la gestion des flux de données par Google.

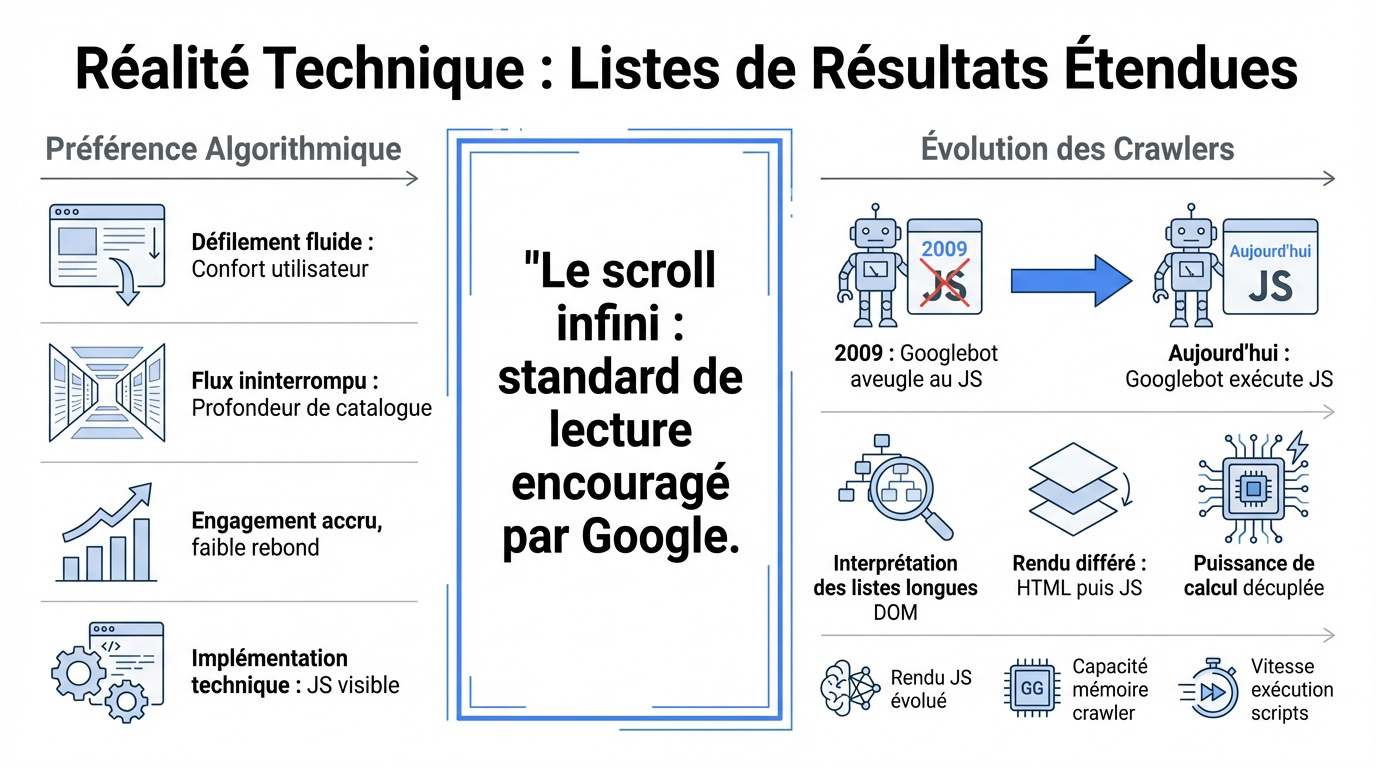

Analyse de la préférence algorithmique pour le contenu continu

Google préconise désormais l’affichage progressif des données. L’algorithme valorise le défilement fluide pour l’utilisateur final. Cette approche garantit une complétude immédiate des informations. C’est un vecteur de confort indéniable pour la navigation mobile.

Le flux ininterrompu modifie la perception qualitative. Une profondeur de catalogue apparente renforce mécaniquement l’autorité du domaine. L’utilisateur perçoit une richesse exhaustive dès le chargement initial.

Le scroll infini n’est pas qu’une mode UX, c’est devenu un standard de lecture que Google encourage pour la découverte exhaustive.

Cette structure limite les points de friction. L’engagement s’intensifie durant la session. Le taux de rebond s’en trouve réduit par l’absence de clics correctifs.

L’implémentation technique doit rester parfaite. Le JavaScript ne doit jamais occulter le contenu aux robots d’exploration.

Évolution des capacités de traitement des crawlers depuis 2009

En 2009, Googlebot ignorait le JavaScript. Aujourd’hui, il exécute le code via un environnement Chromium moderne. Le rendu est désormais universel et sans état.

- 2009 : Googlebot aveugle au JavaScript.

- Aujourd’hui : Exécution complète du JS comme un navigateur moderne.

- Futur : Rendu différé et indexation en deux étapes.

Le crawler déchiffre les structures répétitives du DOM. Il identifie les patterns au sein des listes étendues. Cette compréhension structurelle évite les erreurs d’interprétation. L’indexation gagne en précision chirurgicale.

- Évolution du rendu JS

- Capacité de mémoire du crawler

- Vitesse d’exécution des scripts

Le rendu différé demeure une étape pivot. Google indexe le HTML brut avant de traiter la version générée. Cette double lecture est une priorité technique.

La puissance de calcul allouée aux sites volumineux a progressé. Les inventaires massifs bénéficient d’un traitement fluide. L’exploration est optimisée pour les catalogues denses.

| Critère | Pagination Classique | Liste Étendue / Scroll |

|---|---|---|

| Profondeur de crawl | Élevée (n clics) | Faible (1 clic) |

| Expérience Mobile | Hachée | Fluide |

| Découvrabilité | Séquentielle | Directe via JS |

Architecture structurelle et découvrabilité des URL

Mais attention, cette puissance de rendu ne dispense pas de respecter les fondamentaux du maillage interne.

Standardisation des liens HTML et attributs href

Nous imposons l’usage exclusif de balises conventionnelles. L’attribut href demeure l’unique signal universel interprété par Google. En l’absence de lien physique, le robot d’exploration interrompt systématiquement son parcours devant la liste de résultats.

L’adoption du « tout JavaScript » comporte des risques majeurs. Les déclencheurs de type « onclick » s’avèrent invisibles pour une indexation en profondeur. Cette omission technique constitue une erreur fatale pour la visibilité.

Ce tableau synthétise l’efficacité des méthodes courantes. Seul le lien HTML garantit une indexation exhaustive, contrairement aux solutions purement dynamiques qui masquent le contenu aux robots.

| Méthode | Crawlabilité | Expérience Utilisateur | Recommandation |

|---|---|---|---|

| Lien HTML pur | 5/5 | 3/5 | ✅ |

| Bouton JS avec href | 4/5 | 5/5 | ✅ |

| Bouton JS sans fallback | 1/5 | 4/5 | ❌ |

| Scroll infini seul | 0/5 | 5/5 | ❌ |

Nous préconisons un fallback robuste. Malgré les évolutions technologiques, la simplicité structurelle l’emporte toujours. Un lien textuel brut agit comme une véritable assurance vie pour la pérennité du référencement.

Le maillage interne doit conserver une logique implacable. Chaque segment de liste doit rester accessible par une simple interaction.

Gestion des paramètres de requête et unicité des adresses

La définition d’une structure optimale d’URL segmentées s’impose. Nous privilégions des paramètres explicites tels que « ?page=2 ». Les syntaxes complexes ou cryptiques nuisent à la clarté algorithmique.

Le rejet des identifiants de fragment (#) est catégorique. Google occulte généralement les données suivant ce caractère. Pour une navigation profonde, cette pratique s’apparente à un suicide en matière de visibilité organique.

Google ignore tout ce qui suit le symbole #. Utilisez des paramètres ?page=n à la place.

La distinction entre ressource et ancre locale est fondamentale.

« Une URL qui contient un fragment # n’existe pas aux yeux de l’indexation«

L’unicité de chaque adresse garantit la cohérence du crawl. Chaque état spécifique de la liste doit correspondre à une URL propre. C’est le fondement même de l’architecture web.

Nous surveillons les paramètres superflus. Ils fragmentent l’autorité interne et consument inutilement le budget de crawl alloué.

Pilotage de l’indexation et gestion canonique

Une fois l’architecture en place, il faut dire à Google comment traiter ces pages pour éviter les pièges du duplicate content.

Implémentation des balises canoniques autoréférencées

L’usage d’une canonique propre à chaque segment s’impose. Chaque fragment de liste présente un contenu singulier. Cette spécificité technique exige une reconnaissance d’originalité. Nous désignons ainsi chaque URL comme sa propre référence.

Pointer systématiquement vers la page initiale constitue une erreur. Cette pratique occulte les produits situés en profondeur. L’indexation des pages lointaines devient alors impossible.

Le signal envoyé aux algorithmes gagne en clarté. La balise autoréférencée valide l’existence légitime du document. Elle écarte tout soupçon de duplication accidentelle.

L’existence d’une version globale modifie cette règle. Si un mode « Voir tout » est disponible, il devient la référence unique. Sinon, nous maintenons l’autoréférencement strict.

La cohérence entre le sitemap et les balises demeure impérative. Ces deux vecteurs doivent diffuser une information identique.

Utiliser des canoniques autoréférencées (self-referencing). Ne jamais pointer toutes les pages vers la page 1, sous peine de désindexer les produits profonds.

Différenciation sémantique des métadonnées par page

L’insertion du numéro de page dans la balise Title s’avère efficace. Cette méthode garantit une unicité immédiate. Nous évitons ainsi toute confusion structurelle.

La logique s’applique également au titre H1. Ne maintenez pas un intitulé générique sur cinquante itérations. L’ajout du suffixe Page 2 clarifie l’organisation sémantique. Cette précision facilite le travail des robots.

Cette rigueur prévient les alertes au sein de la Search Console. Des métadonnées identiques provoquent des erreurs de duplication. Une variation mineure suffit à stabiliser l’indexation.

- Modèle de Title dynamique

- Structure de H1 recommandée

- Gestion de la Meta Description

L’optimisation cible également le comportement de l’internaute. Un titre explicite facilite le repérage durant la navigation. Nous produisons ici un SEO réellement utile.

Optimisation des modèles UX pour le crawl

Bref, la technique pure ne suffit pas, il faut aussi penser à l’efficacité du crawl sur le long terme.

Confrontation des modèles Pagination et Load More

La pagination classique demeure un pilier structurel indispensable pour l’architecture. Elle instaure des points d’ancrage fixes pour les robots d’exploration. Ce modèle garantit une indexation sécurisée des segments profonds. Nous observons une stabilité technique supérieure.

Le chargement dynamique ou « Load More » soutient l’engagement sur mobile. Toutefois cette méthode exige un déploiement technique rigoureux. L’absence de liens explicites entrave souvent la découverte du contenu.

Une liste excessivement longue dégrade la performance. Sur mobile un DOM surchargé ralentit la navigation. Le navigateur s’essouffle face à une accumulation de données brutes.

Nous préconisons un modèle hybride stratégique. Le « Load More » sert l’interface utilisateur fluide. La pagination en dur assure la visibilité car pagination-seo-google-prefere-les-longue-liste-de-resultats demeure une interrogation centrale.

Utilisez le Load More ou le Scroll Infini doublé d’une pagination classique (balises <a>) pour les robots.

La surveillance des Core Web Vitals s’avère impérative. Un décalage de mise en page pénalise directement le positionnement organique.

Préservation des ressources d’exploration sur les grands volumes

La hiérarchisation des priorités d’exploration est fondamentale pour la performance. Les pages de détails priment sur les listes profondes. Nous devons allouer le budget de crawl avec une précision chirurgicale constante.

L’application de codes 404 pour les segments inexistants est nécessaire. Si une requête cible la page mille d’une liste courte l’erreur doit être explicite. Google ne doit pas errer inutilement. Cette rigueur préserve l’efficacité globale.

Le fichier robots.txt nécessite une manipulation prudente. Il ne faut pas bloquer la pagination. Limitez simplement les paramètres de tri redondants pour améliorer la trajectoire des robots.

Nous soulignons la nécessité d’une gestion économe.

Le budget de crawl est une ressource finie qu’il faut allouer aux pages génératrices de revenus, pas aux listes infinies.

Cette approche préserve la visibilité.

L’analyse régulière des logs serveur est indispensable pour la surveillance. Elle révèle si les robots s’égarent sur des chemins sans valeur ajoutée.

L’efficience SEO de la pagination exige une architecture conciliant accessibilité algorithmique et fluidité de navigation. Nous préconisons l’adoption immédiate de structures d’URL uniques et de canoniques autoréférencées pour sécuriser vos flux. Valider cette préférence pour les listes de résultats étendues assure une visibilité pérenne et une autorité incontestable.

FAQ

Google privilégie-t-il le défilement infini ou la pagination classique pour le référencement ?

Nous observons que Google ne manifeste pas de préférence intrinsèque pour un modèle d’affichage spécifique, qu’il s’agisse de la pagination traditionnelle, du bouton « Charger plus » ou du défilement infini. L’exigence fondamentale du moteur de recherche réside dans la découvrabilité des contenus : chaque méthode doit permettre aux robots d’accéder à l’intégralité des résultats via des structures techniques identifiables.

Si le défilement infini est souvent plébiscité pour l’expérience utilisateur sur mobile, il doit impérativement s’appuyer sur une architecture de pagination classique en arrière-plan. Nous recommandons de maintenir des URL uniques et des liens physiques pour garantir que le crawler puisse explorer les segments profonds de la liste sans nécessiter d’interaction humaine simulée.

Quelle est l’évolution des capacités de rendu JavaScript de Googlebot depuis 2009 ?

L’analyse rétrospective des capacités de Googlebot révèle une progression technique majeure. En 2009, l’exploration était quasi exclusivement limitée au HTML statique, le moteur étant largement aveugle aux scripts côté client. Aujourd’hui, Google utilise une version « Evergreen » de Chromium, lui permettant d’exécuter le JavaScript et de rendre les pages avec la même précision qu’un navigateur moderne, incluant le contenu chargé de manière asynchrone via des appels API.

Cette transition a permis de valider des modèles de navigation dynamiques autrefois risqués. Toutefois, bien que 100 % des pages analysées bénéficient désormais d’un rendu complet, nous soulignons que les liens présents dans le HTML initial conservent un avantage en termes de rapidité de découverte par rapport aux éléments générés tardivement par le code.

Quelles sont les exigences techniques pour garantir l’exploration des liens de pagination ?

La pérennité de l’indexation repose sur l’utilisation stricte de balises HTML <a> associées à l’attribut href. Nous proscrivons l’usage exclusif d’événements JavaScript de type « onclick » ou de sélecteurs de type « div », car ils ne constituent pas des chemins de navigation explorables pour les algorithmes. Chaque lien doit pointer vers une URL stable et unique, utilisant des paramètres de requête clairs comme « ?page=n ».

Par ailleurs, nous rappelons que l’usage des identifiants de fragment (#) est formellement déconseillé pour la segmentation des listes. Google ignorant systématiquement ce qui suit le symbole dièse, une telle structure rendrait les pages profondes invisibles pour l’indexation. La clarté de l’architecture URL demeure le seul garant d’une exploration exhaustive.

Faut-il implémenter une balise canonique auto-référencée sur chaque page de pagination ?

La doctrine technique actuelle impose l’usage d’une balise canonique auto-référencée pour chaque page composant une séquence. Contrairement à une pratique historique erronée, il ne faut pas faire pointer la balise canonique des pages profondes vers la première page de la liste. Une telle configuration signalerait au moteur que seule la page initiale est pertinente, risquant d’entraîner l’exclusion des produits ou contenus situés sur les pages suivantes.

Chaque segment de liste possédant un contenu unique, il doit être traité comme une entité distincte. Nous précisons toutefois que si une version « Voir tout » (View All) existe et présente l’intégralité des résultats sur une seule adresse, celle-ci doit alors devenir l’URL canonique unique pour l’ensemble de la série paginée.

Comment optimiser le budget de crawl sur les sites disposant de volumes massifs de résultats ?

La gestion du budget de crawl sur les grands domaines nécessite une hiérarchisation stratégique des ressources d’exploration. Nous conseillons de limiter l’accès des robots aux paramètres de tri et de filtrage redondants via le fichier robots.txt, afin de concentrer l’activité de Google sur les pages à forte valeur ajoutée. Il est crucial d’éviter que les robots ne s’égarent dans des combinaisons d’URL infinies ou inutiles.

Enfin, nous préconisons une gestion rigoureuse des erreurs HTTP. Toute page de pagination inexistante ou vide doit impérativement retourner un code d’erreur 404 réel. L’absence de contenu sur une URL répondant en code 200 génère des erreurs de type « soft 404 », ce qui gaspille inutilement les capacités d’analyse allouées par le moteur de recherche.